人工智慧大騙局:一位資深科學家的當頭棒喝

1. 引言:喧囂的炒作與清醒的警鐘

在當今這個被人工智慧(AI)話題徹底佔據的時代,一位科學界的重量級人物正對這場狂歡發起猛烈的抨擊。他不是別人,正是 Ramón López de Mántaras——西班牙乃至全歐洲在 AI 領域的頂尖權威之一。擁有數十年深厚研究背景的他,正以一位內部人士的視角,向我們揭示一個令人不安的真相。

Mántaras 直言不諱地指出,這股席捲全球的風潮,本質上是一場被極度誇大的「大規模行銷活動」(campaña de marketing a gran escala),而大眾正在被「蒙蔽」(tomando el pelo)。他一針見血地提醒我們,無論其表現多麼驚人,AI 的核心依然不變:「這不過是軟體」(es software)。這句話不僅徹底否定了 AI 擁有任何形式的意識,更為全文設定了核心衝突——即市場的過度吹捧與冰冷科學現實之間的巨大鴻溝。

要理解這場騙局的根源,我們必須首先回到一切的起點,從一個致命的語義陷阱開始。

2. 拆解「智慧」:一個致命的語義陷阱

這場大規模混亂的核心,始於一個根本性的錯誤。在 Mántaras 看來,早在 1956 年「人工智慧」這個名稱被創造出來時,就埋下了一顆語義的定時炸彈。這個極具擬人化色彩的術語,不僅誘使我們將人類特質投射到機器上,更為後續數兆美元的市場炒作提供了最完美的行銷外衣。

Mántaras 強調,目前的 AI 在人類的意義上並非真正的「智慧」。他引用 AI 先驅 Marvin Minsky 的「手提箱詞彙」(Suitcase words)概念,來解釋這個問題的嚴重性。像「智慧」、「思考」、「學習」這類詞語,就像一個可以塞進各種不同含義的手提箱,其模糊性正是導致誤解的溫床,也是商業敘事得以乘虛而入的絕佳機會。

為了揭示其中的差異,我們可以對比兩種根本不同的語義學:

• 指稱語義學 (Semántica denotacional): 這是人類語言的基石。詞語與其在真實世界中所指代的對象之間存在著緊密的連結。當我們說「桌子」,這個詞連結的是我們關於家庭晚餐的記憶、木頭的觸感以及穩固性的概念。它是有根的。

• 分佈式語義學 (Semántica distributiva): 這則是大型語言模型(LLM)所擁有的「語義」。它完全缺乏真實世界的根基,僅僅是透過分析海量文本,計算出詞語之間的統計鄰近性。對 LLM 而言,「桌子」只是「椅子」、「木頭」和「吃飯」的統計學鄰居,一個完全沒有體驗、沒有記憶、沒有實體的符號。

Mántaras 的結論是,當前的 AI 系統由於缺乏一個「世界模型」(modelo del mundo),根本無法真正理解語言的意義。這種理解上的錯覺,同樣延伸到了它們的「推理」能力上,而一個巧妙的實驗,便足以無情地戳破這個假象。

3. 理解的幻覺:是「反芻」,而非「推理」

要揭開大型語言模型看似智能的表象,沒有比 Mántaras 所引用的技術論證更具說服力的了。一項針對西洋棋規則的反事實測試(Pruebas contrafactuales),無情地暴露了 LLM 運作機制的真相。

實驗設計堪稱精妙:

• 第一步: 在正常的西洋棋棋盤佈局下,研究人員向多個頂尖 LLM 展示合法的開局走法,模型的判斷準確率高達 90% 以上。

• 第二步: 接下來,他們對規則進行了一個極其微小的改動——僅僅將棋盤上「馬」與「象」的初始位置互換。

• 驚人結果: 在這個訓練數據庫中從未出現過的全新情境下,模型的準確率瞬間崩潰至 54%,這與隨機猜測(echar la moneda al aire)無異。

一個真正具備推理能力的系統,會在新規則下意識到「這是一種類似西洋棋但規則不同的遊戲」,並根據新規則進行判斷。LLM 的失敗,證明了它連這個最基本的抽象步驟都無法完成。它的答案並非來自於對規則的真正理解與邏輯推理,而僅僅是從其龐大的訓練數據庫中「反芻」(regurgitan)出最相似的模式。

「這對我來說是決定性的證據,證明它們在反芻,而不是在推理。」

—— Ramón López de Mántaras

這個實驗不僅揭示了技術的短板,更暴露了市場敘事與科學現實之間一道不可逾越的鴻溝。既然「智慧」如此脆弱,那麼驅動這股狂熱的,必然是比技術本身更強大的力量。

4. 誇大的經濟引擎:跟著錢走

當我們將視角從技術層面轉向社會經濟層面,這場 AI 狂熱的圖景就變得異常清晰。在 Mántaras 犀利的剖析下,Sam Altman、Elon Musk 等科技巨頭的領軍人物,都是「可疑人物」(nombres sospechosos)。

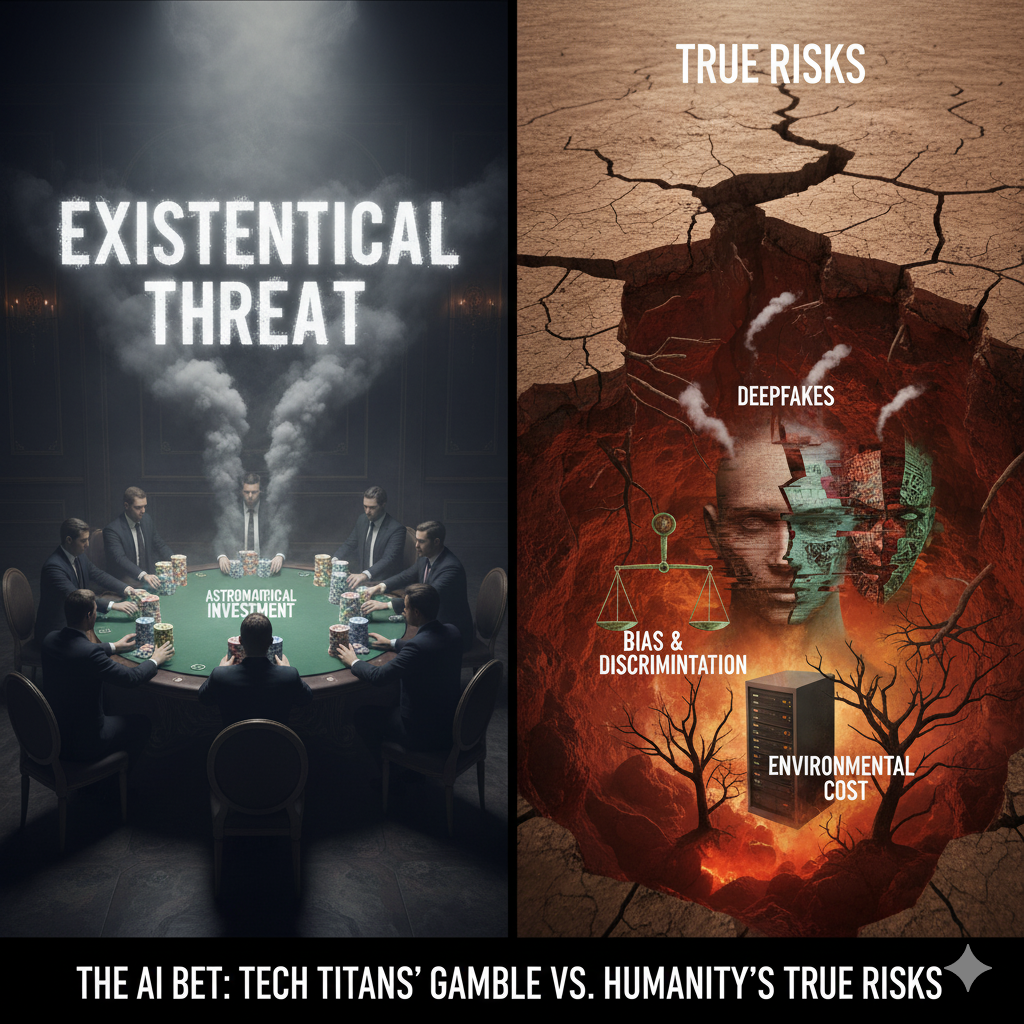

在他看來,這些人之所以不斷宣揚通用人工智慧(AGI)即將在 2026 或 2027 年到來,並大肆渲染 AI 可能帶來的「生存威脅論」,其背後有著極為現實的商業動機。像 OpenAI 這樣的公司仍在持續虧損,它們需要一個宏大甚至帶有末日色彩的敘事——一個被 Mántaras 斥為「完全錯誤」(completamente falso)的預言——來吸引維持其運營所需的「天文數字般的投資」(inversiones pero astronómicas)。

換句話說,「生存威脅論」更像是一種精心設計的「煙霧彈」(cortina de humo)。它的真正作用,是將公眾和監管機構的注意力從 AI 當下所構成的、真實且緊迫的風險上轉移開。在這些被無限誇大的末日威脅背後,正隱藏著一系列被刻意忽視的現實危險。

5. 我們忽視的真正危險:一幕便利的煙幕

當科技巨頭們將 AI 的威脅比作電力或車輪的發明時,Mántaras 坦言這讓他「毛骨悚然」(se me ponen un poco los pelos de punta)。這種誇張的類比,恰恰是為了掩蓋那些真實且迫在眉睫的威脅。這些危險並非遙遠的科幻場景,而是正在侵蝕我們社會根基的現實問題。

與那些被炒作的「末日論」形成鮮明對比的,是 Mántaras 指出的真正危險:

• 權力過度集中: 這才是權力失衡的真正樣貌——不是遙遠的超級智慧,而是當下由「半打」(media docena)大型科技公司對技術方向的絕對壟斷。學術界已在這場競賽中徹底失去了主導權。

• 資訊操縱與造假: 這才是對民主的直接威脅——不是終結者,而是深度偽造(Deepfakes)與大規模假新聞的泛濫,它們正以前所未有的規模侵蝕著社會的信任基礎,並對選舉公正性構成嚴重威脅。

• 偏見與歧視: 這才是演算法的內建暴力——不是機器暴動,而是由於訓練數據本身就包含了人類社會的既有偏見,AI 不僅會複製這些偏見,更會將其固化、放大,從而加劇社會不公。

• 驚人的環境成本: 這才是對地球的實際損害——不是機器佔領,而是訓練和運行大型模型需要消耗「驚人」(brutal)的電力與水資源。在氣候變遷日益嚴峻的今天,這是一個不可忽視的代價。

Mántaras 悲觀地認為,在當前的局面下,AI 帶來的「危害」(perjuicios)可能已經超過了它所創造的「益處」(beneficios),整個天平已經向負面傾斜。

6. 結論:呼喚批判性思維與一條新路

Ramón López de Mántaras 的觀點並非全盤否定 AI 的價值,而是一場對理性的緊急呼籲。他真正希望傳達的,是希望大眾能夠保持「批判性思維」(sentido crítico),不要輕易相信媒體上那些「AI 發現了...」、「AI 掌握了...」的聳動標題,並認識到其背後的軟體本質。

事實上,他對 AI 在特定領域的應用給予了高度肯定,尤其是在醫學與生物醫藥領域。像 AlphaFold 這樣的工具在蛋白質結構預測上取得的突破,正是 AI 作為強大輔助工具發揮巨大價值的典範,這也證明了他的立場是務實而非守舊的。對於未來,Mántaras 提出了一條更為穩健的發展路徑:將 AI 技術與機器人學深度結合,賦予其一個能夠與物理世界互動的「身體」(cuerpo)。他相信,只有透過真實的物理感知,AI 才有可能真正建立起世界模型並理解因果關係。

歸根究底,Mántaras 的警示並非反對技術,而是反對一場正在掏空我們批判性思維、扭曲公共話語、並將未來託付給少數利益集團的「行銷騙局」。當代價是真實的民主、環境與社會公義時,我們沒有權利再繼續被軟體的花言巧語所蒙蔽。

資料來源:YouTube 影片: "La gran mentira de la Inteligencia Artificial 🤖 | 🎙️ Ramón L. de Mántaras - Podcast IA ", Inteligencia Artificial 頻道。